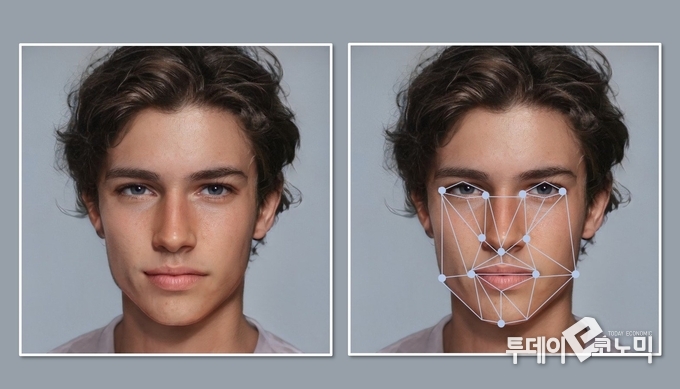

[투데이e코노믹 = 이지혜 기자] 딥페이크를 포함, 증가하는 각종 위·변조 영상에 업계가 전쟁을 선포했다. 무기는 ‘인공지능(AI)’다.

네덜란드 사이버 보안기업 ‘딥트레이스’가 발표한 보고서에 따르면, 지난해 확인된 딥페이크는 1만4678건이다. 전년 대비 84% 증가한 수치다.

최근에는 이런 딥페이크를 통해 여성의 얼굴을 합성, 범죄에 악용하는 사례도 늘고 있다. BBC가 지난달 보도한 것에 따르면, 정보업체 센시티는 지난해 7월부터 1년동안 텔레그램의 ‘딥페이크 봇’ 대화방에서 가짜 나체 사진이 유포돼 피해를 본 여성이 10만5000명이라는 내용의 보고서를 발표했다.

학계와 IT업계는 인공지능을 활용해 딥페이크를 잡는 기술을 개발하고 있다.

한국과학기술원(KAIST) 전산학부 이흥규 교수 연구팀은 3일 인공신경망을 이용해 디지털사진의 변형 여부를 탐지하는 소프트웨어 ‘카이캐치’를 개발했다고 밝혔다. 이는 국내 최초이자 세계 두번째 사례다.

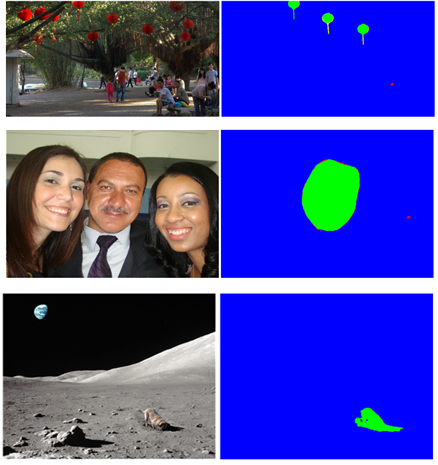

연구팀은 2015년 6월부터 ‘디지털 이미지 위·변조 식별 웹서비스’를 통해 수집한 30여만장의 실유통 이미지 데이터와 신경망 기반의 포렌식 영상 데이터, 딥페이크 실험 영상 자료 등을 정밀 분석했다.

또 잘라 붙이기, 복사 붙이기, 지우기, 이미지 내 물체 크기 변화와 이동, 리터칭 등 일상적이면서 자주 발생하는 변형들에서 언제나 발생하는 변이들을 분류·정리한 뒤 종합 탐지하도록 했다.

그 결과 변형의 유형을 특정하지 못하는 상태에서도 변형이 발생했는지 여부를 정확히 판단, 탐지 신뢰도를 높였다.

마이크로소프트는 지난달 9월 ‘마이크로소프트 비디오 어센케이터’를 발표했다. 인간의 눈으로 알 수 없는 수준의 퇴색과 그레이스케일 등을 검출한 뒤 ‘신뢰점수’를 계산해 딥페이크가 사용됐는지 여부를 알 수 있도록 표시한다.

다만 딥페이크 위변조 여부를 직접 확인할 수 있는 분석도구는 현재 존재하지 않는다. 정확도가 크게 떨어지기 때문이다.

‘카이캐치’의 경우 변형 유형을 알지 못하는 무작위 이미지에 대해서는 평균 탐지 정확도 90~95%의 높은 정확도를 보이지만, 딥페이크 이미지에 대해서는 탐지 정확도가 낮아 추가 연구가 필요한 상황이다.

페이스북이 지난해 12월부터 올해 3월말까지 총 상금 100만 달러를 걸고 진행한 ‘딥페이크 식별 챌린지’에서도 1위를 차지한 AI 모델의 가짜 탐지율은 65%에 그쳤다. 2114명의 참가자가 3만 5000여개의 서로 다른 알고리즘으로 10만 개 이상의 클립으로 구성된 데이터 세트에서 조작 동영상을 식별하는 과정을 거쳤다.

방송통신심의위원회 디지털성범죄심의지원단의 이용배 확산방지팀장은 3일 본지와의 통화에서 “아직까지는 기술적으로 해당 영상이 딥페이크인지 아닌지 정확히 판단할 수 있는 기술력이 확보되어 있는 상황이 아니기 때문에, 피해자로부터 받는 신고나 당국의 모니터링을 바탕으로 인터넷 상에서 정보를 확인하고 있다”고 설명했다.